在当今地理信息系统(GIS)、遥感与大数据分析深度融合的时代,对全球范围进行高效、精准的测图需求日益迫切。传统单机或小型服务器在处理海量全球地理空间数据时,往往面临计算能力不足、处理速度慢、存储瓶颈等挑战。与此大规模超级计算中心虽然性能强大,但建设与维护成本高昂,并非所有机构都能承担。因此,基于小规模集群计算环境,开发高效、可扩展的全球测图技术,成为了一个具有重要实践价值的研究方向。本次分享将围绕这一主题,探讨相关的计算机软硬件关键技术开发。

一、技术背景与挑战

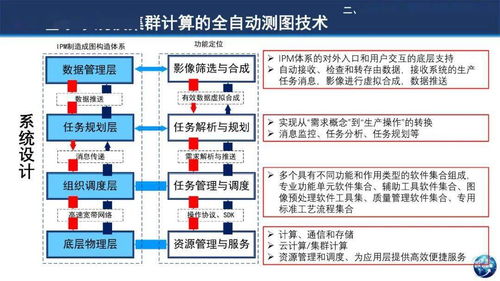

全球高效测图涉及对多源、多时相、高分辨率遥感影像(如卫星影像、航空影像)进行自动化处理,包括几何校正、辐射校正、影像匹配、数字表面模型(DSM)生成、正射纠正、镶嵌与匀色等一系列复杂流程。数据量常达TB乃至PB级,对计算I/O、内存、并行处理能力提出了极高要求。小规模集群通常指由数个到数十个计算节点通过高速网络互联构成的系统,其核心挑战在于如何在有限的硬件资源下,实现计算任务的高效调度、负载均衡与数据管理,以接近线性加速比完成全球测图任务。

二、核心硬件架构设计

- 异构计算集群构建:采用CPU与GPU(或其它加速器如FPGA)相结合的异构架构。CPU负责复杂的逻辑控制、任务调度与I/O密集型操作,而GPU凭借其强大的并行计算能力,高效处理影像匹配、密集匹配、三维重建等计算密集型核心算法。

- 高速存储与网络:配置高性能并行文件系统(如Lustre, Ceph)或全闪存阵列,以满足海量影像数据的高吞吐量读写需求。计算节点间采用InfiniBand或高速以太网进行互联,减少节点间通信延迟,保障并行效率。

- 可扩展性与成本效益:硬件设计遵循模块化原则,支持通过增加计算节点或存储节点进行横向扩展。选用性价比高的商用硬件(COTS),在控制总体成本的通过软件优化最大化硬件性能。

三、关键软件技术与算法优化

- 并行计算框架与任务调度:

- 基于MPI(消息传递接口)、OpenMP等多线程与多进程编程模型,实现算法级并行。

- 采用成熟的集群任务管理系统(如Slurm, Kubernetes with HPC扩展)或开发定制化调度器,实现细粒度的任务动态分配与负载均衡,确保所有计算单元均处于高效工作状态。

- 设计面向测图流水线的有向无环图(DAG)任务模型,自动管理任务间的依赖关系与数据流。

- 全球测图核心算法并行化与优化:

- 影像匹配与特征提取:将SIFT、SURF、ORB等特征提取算法以及密集匹配算法移植到GPU上,实现成千上万幅影像特征的快速并行提取与匹配。

- 空三解算与平差:对大范围乃至全球区域的影像进行分区平差,采用分布式优化算法(如分布式束调整)解决超大规模稀疏矩阵求解问题,突破单机内存限制。

- DSM/DEM生成与正射纠正:将每个像元或每个小格网的计算任务映射到不同的GPU线程或CPU核心上,实现极致并行。采用金字塔与瓦片(Tile)数据组织方式,便于并行处理和内存管理。

- 高效数据管理与I/O优化:

- 设计全球多级瓦片索引系统,实现海量影像与成果数据的快速定位与检索。

- 利用内存计算(In-Memory Computing)技术,将频繁访问的中间数据或元数据常驻内存,减少磁盘I/O。

- 实现计算与I/O的重叠(异步I/O),使数据预取与计算同时进行,隐藏I/O延迟。

- 容错与弹性计算:在软件层面设计检查点(Checkpoint)机制和任务重试策略,当某个节点或任务失败时,能够快速恢复,保障长时间运行的大规模作业的可靠性。

四、系统集成与性能评估

将上述软硬件技术集成,构建一套完整的“全球高效测图处理系统”。通过真实全球数据集(如LandSat, Sentinel系列全球存档数据)进行测试,关键性能指标包括:

- 处理吞吐量:单位时间内能够完成测图处理的面积(如平方公里/天)。

- 加速比与并行效率:相对于单节点或单机方案的性能提升比例,以及随着节点增加,性能提升的线性程度。

- 成果精度:生成的全球正射影像图、DSM等产品的几何与辐射精度。

- 系统能耗与成本效益分析:完成单位面积测图任务所消耗的能源与总拥有成本(TCO)。

五、应用前景与

基于小规模集群的全球高效测图技术,为科研机构、中型企业乃至部分国家级项目提供了可行的技术路径。它不仅能应用于全球基础地理信息数据库的快速更新、全球环境变化监测、数字地球建设,也可为智慧城市、自动驾驶高精地图快速生产等区域性应用提供底层技术支持。随着云计算与边缘计算的发展,该技术栈可进一步演化为混合云或云边协同的测图服务模式。

通过精心的软硬件协同设计、算法深度并行优化与高效的系统调度管理,在小规模集群计算环境下实现全球范围的高效测图是完全可行的。这不仅是计算机软硬件技术在地学领域的一次成功深度应用,也为处理其他领域的超大规模计算问题提供了有益借鉴。

---

讨论与交流

欢迎就集群规模的具体界定、特定算法的GPU优化细节、开源工具链的选择(如OpenSfM, MicMac在集群上的部署优化)以及实际部署中遇到的网络与存储瓶颈等问题进行深入探讨。